Seafile Server - Installation auf Ubuntu 24.04.x LTS: Unterschied zwischen den Versionen

Aus znilwiki

BLinz (Diskussion | Beiträge) |

BLinz (Diskussion | Beiträge) |

||

| Zeile 432: | Zeile 432: | ||

==Python '''virtual environment''' erstellen== | ==Python '''virtual environment''' erstellen== | ||

Wir sind als Benutzer seafile angemeldet und befinden uns im Ordner <code>/home/seafile/haiwen</code>!<br> | Wir sind als Benutzer seafile angemeldet und befinden uns im Ordner <code>/home/seafile/haiwen</code>!<br> | ||

python3 -m venv python-venv | |||

# activate the venv | |||

source python-venv/bin/activate | |||

Version vom 13. Juni 2024, 15:25 Uhr

Changelog:

- 13.06.2024 erste Version

Installation Ubuntu Server 24.04.x LTS (Long Term Support)

Einstellungen für die VM

Falls Ihr den Seafile-Server als virtuelle Maschine (VM) installiert so könnt Ihr Beispielsweise folgenden Einstellungen nehmen. Diese berücksichtigen auch die Mindestanforderungen von Ubuntu 24.04

- Konfiguration: Typisch

- Name und Speicherort: Nach eigener Wahl

- Speicher: Nach eigener Wahl

- Gastbetriebssystem: (*) Linux --> Ubuntu (64-Bit)

- Netzwerk:

- Wie viele Netzwerkkarten möchten Sie anschließen: 1

- Netzwerk: Nach Wahl (VM Network?)

- Adapter: VMXNET 3

- Größer der virtuellen Festplatte:

- Hängt von der Anzahl der überwachten Geräte / Items ab.

- Ich empfehle min 32GB für das Betriebssystem des Servers. Für die Datenpartition hängen wir später noch eine zweite Festplatte an.

- Die Festplatte kann bei einer VM nachträglich vergrößert werden - siehe dazu den Abschnitt in diesem Artikel weiter unten

- Thick-Provision Lazy-Zeroed

Danach Einstellungen der VM bearbeiten: Reiter Hardware:

- Arbeitsspeicher:

- 4GB oder mehr

- CPUs:

- Anzahl der virtuellen Sockets

- 4 oder mehr

- Anzahl der Cores pro Socket: 1 (Immer Anzahl der Sockets erhöhen)

- Anzahl der virtuellen Sockets

Reiter Optionen

- ...

Grundinstallation

CD einlegen und los,

die Fragen beantwortet Ihr wie folgt (sind ggf. die Überschriften der Dialoge):

Try or Install Ubuntu Server

Deutsch

German / German

- Wenn er einen neueren Installer findet und fragt ob er auf diesen aktualisieren soll - Ja!

Ubuntu Server

Ubuntu ServerJetzt könnt Ihr schon die gewünschte feste IP-Adresse einstellen. Wählt dazu mit den Pfeiltasten den

ens160Eintrag aus und drückt Enter:ens192 => Bearbeite IPv4

Manuell

Bei Subnetz kommt nicht die Subnetzmaske sondern das Netzwerk mit Suffix. Bei einer 24 Maske (= 255.255.255.0) ist das die IP 0 mit Suffix /24

Erledigt

Bei Bedarf, sonst leer lassen

Erledigt

Nutzt die ganze Festplatte ohne LVM (also Haken entfernen). Die Festplatte lässt sich später trotzdem leicht vergrößern

Erledigt

Fortfahren

Den Servernamen festlegen. Ich lege hier den Benutzer installadmin an. Wählt euren Benutzer und Passwort nach Wunsch (Aufschreiben!)

Der Benutzer sollte NICHT seafile sein, den legen wir separat an für den Dienst

Falls Ihr Ubuntu Pro habt, könnet Ihr es hier aktiveren, ansonsten einfach [Fortfahren]

OpenSSH-Server auswählen => Erledigt (für Zugriff z.B. mit Putty)

Erledigt

Ab jetzt heißt es abwarten. Wenn er kann lädt er gleich ein paar Sicherheitsupdates nach:

Jetzt neustarten

ISO aus der VM entfernen und Enter drücken

Nach dem Reboot wartet ab bis diverse Meldungen abgelaufen sind

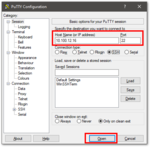

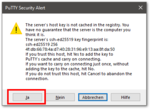

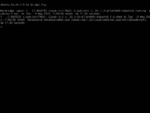

PuTTY

Ab dieser Stelle könnt Ihr PuTTY oder den SSH Client eurer Wahl nutzen - was ich dringend empfehle. Denn dann könnt Ihr hier vorgeschlagenen Befehle einfach per Copy&Paste übernehmen.

Die IP-Adresse habt Ihr zu diesem Zeitpunkt ja bereits festgelegt:

Nach der Anmeldung nutze ich immer gerne ein

sudo -i

Damit wechselt man dauerhaft zum root Benutzer und muss nicht vor jedem Befehl ein sudo stellen.

root wieder freischalten

sudo verwendet müsst Ihr selbst wissen- Mit Benutzer installadmin anmelden

sudo -i

- Kennwort des Benutzer installadmin eintippen

passwd root

- neues Kennwort für "root" 2x eintippen

- Lokal Anmelden kann man sich nun mit root - aber eine Anmeldung über SSH funktioniert dann immer noch nicht.

- Damit diese auch funktioniert müsst ihr die

sshd_configbearbeiten:

nano /etc/ssh/sshd_config

sucht nach der Zeile (STRG + W ist Suchen) nach

#PermitRootLogin without-password

und stellt den Cursor in die Zeile.

Drückt nun einmal F9 und 2x F10 - damit erstellt Ihr eine Kopie der Zeile.

Ändert die Kopie wie folgt ab:

PermitRootLogin yes

Speichert die Datei (STRG + x, dann y und Enter) und startet den ssh Dienst neu:

systemctl restart ssh.service

Ab dann klappt es auch mit dem SSH-Login für den Benutzer root, z.B. über puTTY

Jetzt 2x

exit

eintippen wodurch sich das PuTTY Fenster schließt - der (eingeschränkte) Benutzer installadmin hat sich somit abgemeldet

Ja, ich persönlich arbeite gerne als root und habe diesen für die Anmeldung freigeschaltet. Was ich nicht mache ist das Login per SSH mit Passwort zu erlauben. Ich hinterlege also immer einen SSH-Key für die Anmeldung und nutze diesen statt des Kennwortes. Die Lösung hier ist einfach gehalten, der Profi mögen anpassen wie er es braucht. Ein Anmeldung als eingeschränkter Benutzer geht natürlich auch, das erste was ich dann immer mache ist ein

sudo -i um dauerhaft zum root zu wechselnAnmelden als root

Startet PuTTY wieder und meldet euch diesmal gleich als Benutzer root an.

nano & Co auf Deutsch

nano war eben z.B. noch auf Englisch, mit

apt install -y language-pack-de

ist es (und vieles andere) auf deutsch.

root farbiger Prompt

Als root anmelden:

nano ~/.bashrc

Zeile 39 (Alt + C aktiviert Zeilennummernanzeige):

#force_color_prompt=yes

ändern zu (# entfernen):

force_color_prompt=yes

nun wieder Abmelden - ab der nächsten Anmeldung ist der neue Prompt aktiv.

Wer den sofort haben will (ohne neu Anmelden):

source ~/.bashrc

Feste IP-Adresse vergeben

Der Server hat dank des neuen Setupdialoges nun bereits eine feste IP-Adresse.

Solltet Ihr an dieser etwas ändern müssen so müssen wir erst das Cloud-Init deaktivieren:

nano /etc/cloud/cloud.cfg.d/99-disable-network-config.cfg

Inhalt:

network: {config: disabled}

Dann könnte Ihr in der folgenden Datei etwas ändern, die Warnungen das es einen reboot nicht übersteht könnt Ihr ignorieren, dafür haben wir die andere Datei angelegt.

nano /etc/netplan/50-cloud-init.yaml

Updates einspielen

- wieder anmelden als root bzw. zum root wechseln

- Updates suchen für Betriebssystem: (aktualisiert den Katalog aus den Update-Quellen)

apt update

- Updates einspielen:

apt upgrade -y

- Nach Update überflüssige Pakete entfernen:

apt autoremove -y

Ich mache das normalerweise immer als Einzeiler:

apt update && apt upgrade -y && apt autoremove -y

Multipathing deinstallieren (wenn der Server eine VM ist)

Ab Werk wird nun das

/var/log/syslog

mit Multipath-Meldungen vollgemüllt:

2024-05-27T12:32:47.571374+00:00 ubuntu2404 systemd[1]: Started multipathd.service - Device-Mapper Multipath Device Controller. 2024-05-27T12:32:47.592304+00:00 ubuntu2404 kernel: systemd[1]: Listening on multipathd.socket - multipathd control socket. 2024-05-27T12:32:47.592385+00:00 ubuntu2404 kernel: systemd[1]: Starting multipathd.service - Device-Mapper Multipath Device Controller... 2024-05-27T12:32:48.141146+00:00 ubuntu2404 multipathd[467]: sda: failed to get udev uid: No data available 2024-05-27T12:32:48.141212+00:00 ubuntu2404 multipathd[467]: sda: failed to get path uid 2024-05-27T12:32:48.141278+00:00 ubuntu2404 multipathd[467]: uevent trigger error 2024-05-27T12:32:57.634912+00:00 ubuntu2404 multipathd[467]: sda: triggering change event to reinitialize 2024-05-27T12:32:57.667862+00:00 ubuntu2404 multipathd[467]: sda: failed to get udev uid: No data available 2024-05-27T12:32:57.667930+00:00 ubuntu2404 multipathd[467]: sda: failed to get path uid 2024-05-27T12:32:57.667959+00:00 ubuntu2404 multipathd[467]: uevent trigger error 2024-05-27T12:33:07.637080+00:00 ubuntu2404 multipathd[467]: sda: triggering change event to reinitialize 2024-05-27T12:33:07.676773+00:00 ubuntu2404 multipathd[467]: sda: failed to get udev uid: No data available 2024-05-27T12:33:07.676839+00:00 ubuntu2404 multipathd[467]: sda: failed to get path uid 2024-05-27T12:33:07.676865+00:00 ubuntu2404 multipathd[467]: uevent trigger error 2024-05-27T12:33:17.641466+00:00 ubuntu2404 multipathd[467]: sda: triggering change event to reinitialize 2024-05-27T12:33:17.709843+00:00 ubuntu2404 multipathd[467]: sda: failed to get sysfs uid: No such file or directory 2024-05-27T12:33:17.709915+00:00 ubuntu2404 multipathd[467]: sda: failed to get sgio uid: No such file or directory 2024-05-27T12:33:17.709942+00:00 ubuntu2404 multipathd[467]: sda: failed to get path uid 2024-05-27T12:33:17.709969+00:00 ubuntu2404 multipathd[467]: uevent trigger error 2024-05-27T12:33:28.134951+00:00 ubuntu2404 multipathd[467]: sda: not initialized after 3 udev retriggers 2024-05-27T12:33:29.139933+00:00 ubuntu2404 multipathd[467]: sda: add missing path 2024-05-27T12:33:29.140037+00:00 ubuntu2404 multipathd[467]: sda: failed to get sysfs uid: No such file or directory 2024-05-27T12:33:29.140063+00:00 ubuntu2404 multipathd[467]: sda: failed to get sgio uid: No such file or directory 2024-05-27T12:33:29.140086+00:00 ubuntu2404 multipathd[467]: sda: no WWID in state "undef 2024-05-27T12:33:29.140109+00:00 ubuntu2404 multipathd[467]: ", giving up 2024-05-27T12:33:29.140181+00:00 ubuntu2404 multipathd[467]: sda: check_path() failed, removing

Unter Ubuntu 24.04/22.04 scheint es nicht mehr ganz so schlimm wie unter 20.04 - aber in einer VM macht Multipath keinen Sinn, also deaktivieren und deinstallieren um das Syslog von den Meldungen befreien:

systemctl stop multipathd.service && systemctl disable multipathd.service apt install kpartx libsgutils2-1.46-2 sg3-utils sg3-utils-udev apt remove -y multipath-tools && apt purge -y multipath-tools

Die apt install Zeile ist da drin weil diese Pakete ggf. von anderen Anleitung vorausgesetzt werden. Die Pakte werden dadurch auf manuell installiert gesetzt und dann nicht bei einem apt autoremove deinstalliert

Cloud-Init deinstallieren (Wenn es keine VM bei einem Cloudanbieter ist)

Wenn Ihr die VM reboootet und die Console betrachtet tauchen kurz nach dem Reboot (Fehler-)Meldungen zum Cloud-init auf:

Das Cloud-Init ist - wenn ich mich recht erinnere - dafür da falls eure VM z.B. bei Amazon AWS, Azure oder andere Anbieter läuft um z.B. die Netzwerkinformationen vom Hoster/Provider zu erhalten.

Brauchen wir nicht, also weg damit:

echo 'datasource_list: [ None ]' | tee /etc/cloud/cloud.cfg.d/90_dpkg.cfg apt purge -y cloud-init rm -rf /etc/cloud/ && sudo rm -rf /var/lib/cloud/ apt install eatmydata libeatmydata1 python-babel-localedata python3-babel python3-jinja2 python3-json-pointer python3-jsonpatch python3-jsonschema python3-markupsafe python3-pyrsistent python3-tz -y reboot

Die apt install Zeile ist da drin weil diese Pakete ggf. von anderen Anleitung vorausgesetzt werden. Die Pakte werden dadurch auf manuell installiert gesetzt und dann nicht bei einem apt autoremove deinstalliert

Zeitzone setzen

In meiner VM ist die Uhrzeit zu diesem Zeitpunkt falsch (gebt mal probeweise date ein) - weil der ESXi-Host auf UTC Zeit läuft und die Ubuntu in der VM die richtige Zeitzone nicht eingestellt hat.

Wir korrigieren das mit

timedatectl set-timezone Europe/Berlin

ein

date

sollte dann die richtige Uhrzeit ausspucken.

Zeitserver setzen

Für die Zeitsynchronisierung ist der Dienst systemd-timesyncd.service zuständig, dieser wird über die Datei

nano /etc/systemd/timesyncd.conf

konfiguriert:

# This file is part of systemd.

#

# systemd is free software; you can redistribute it and/or modify it under the

# terms of the GNU Lesser General Public License as published by the Free

# Software Foundation; either version 2.1 of the License, or (at your option)

# any later version.

#

# Entries in this file show the compile time defaults. Local configuration

# should be created by either modifying this file (or a copy of it placed in

# /etc/ if the original file is shipped in /usr/), or by creating "drop-ins" in

# the /etc/systemd/timesyncd.conf.d/ directory. The latter is generally

# recommended. Defaults can be restored by simply deleting the main

# configuration file and all drop-ins located in /etc/.

#

# Use 'systemd-analyze cat-config systemd/timesyncd.conf' to display the full config.

#

# See timesyncd.conf(5) for details.

[Time]

NTP=192.168.1.81

FallbackNTP=192.168.1.198 de.pool.ntp.org

#RootDistanceMaxSec=5

#PollIntervalMinSec=32

#PollIntervalMaxSec=2048

#ConnectionRetrySec=30

#SaveIntervalSec=60Sowohl die Liste der NTP= als auch der FallbackNTP= erwartet eine per Leerzeichen getrennte Liste der möglichen Server.

Laut Anleitung hört der Dienst aber beim ersten Treffer auf zu suchen. In der Praxis setzt also einen NTP-Server und ggf. die Fallback. Setzt Ihr einen Wert nicht, lasst diesen also auskommentiert, so gilt der Default-Wert, beim Fallback gilt dann FallbackNTP=ntp.ubuntu.com.

Nach der Änderung müsst Ihr den Dienst einmal neu starten:

systemctl restart systemd-timesyncd.service

und mit folgenden Befehl könnt Ihr den Status abfragen:

timedatectl show-timesync

Beispielausgabe:

LinkNTPServers=fd00::1eed:6fff:fe71:f1c0

SystemNTPServers=192.168.1.81

FallbackNTPServers=192.168.1.198 de.pool.ntp.org

ServerName=192.168.1.81

ServerAddress=192.168.1.81

RootDistanceMaxUSec=5s

PollIntervalMinUSec=32s

PollIntervalMaxUSec=34min 8s

PollIntervalUSec=2min 8s

NTPMessage={ Leap=0, Version=3, Mode=4, Stratum=3, Precision=-23, RootDelay=20.324ms, RootDispersion=28.579ms, Reference=C0A801C6, OriginateTimestamp=Tue 2024-06-04 08:22:24 CEST,

ReceiveTimestamp=Tue 2024-06-04 08:22:24 CEST, TransmitTimestamp=Tue 2024-06-04 08:22:24 CEST, DestinationTimestamp=Tue 2024-06-04 08:22:24 CEST, Ignored=no, PacketCount=2, Jitter=239us }

Frequency=1158037

Automatische Updates deaktivieren

Ich persönlich möchte nicht das der Zabbix-Server automatisch Updates einspielt.

Die automatischen Updates aktualisieren - soweit ich das beobachten konnte - nur den Kernel. Aber auch das möchte ich nicht. Ich möchte das geplant durchführen.

Die automatischen Updates verhindern wir mit

apt remove -y unattended-upgrades

Zusätzliche Festplatte einbinden

Die Daten von Seafile sollen auf einer 2. Festplatte gespeichert werden - exklusive der SQL-Datenbank, diese wird auf der Festplatte mit dem Betriebssystem liegen.

Dazu habe ich der VM einfach eine weitere Festplatte mit 50GiB hinzugefügt. Diese können wir später bei bedarf einfach vergrößern.

Nach dem hinzufügen startet Ihr den Server einmal neu.

Zuerst müssen wir herausfinden wie die 2. Festplatte unter Ubuntu heißt:

ls -l /dev/sd*

Ausgabe:

brw-rw---- 1 root disk 8, 0 Jan 29 10:46 /dev/sda

brw-rw---- 1 root disk 8, 1 Jan 29 10:46 /dev/sda1

brw-rw---- 1 root disk 8, 2 Jan 29 10:46 /dev/sda2

brw-rw---- 1 root disk 8, 16 Jan 29 10:46 /dev/sdb/dev/sda ist die erste Festplatte, sda1 und sda2 sind Partitionen auf dieser.

Unsere Zielfestplatte Platte ist die /dev/sdb

Da wir hier keine /dev/sdb1 sehen hat diese Festplatte noch keine Partitionen.

Ich arbeite hier ohne LVM, die Festplatte können wir später trotzdem leicht vergrößern.

/dev/sda1 sondern nur /dev/sda

Wir tippen ein:

fdisk /dev/sdb

Da kommt dann etwas Text und die Aufforderung

Befehl (m für Hilfe):

Wir drücken

n

um eine neue Partition zu erstellen und dann

p

für eine Primäre Partition, dann

1

für die erste Partition.

Dann drückt 2x Enter um die vorgeschlagenen Werte zu übernehmen.

Jetzt sollte da wieder

Befehl (m für Hilfe):

stehen und wir drücken

w

um das ganze auf die Platte zu schreiben.

Das sollte also etwas so aussehen:

root@cloudserver:~# fdisk /dev/sdb

Willkommen bei fdisk (util-linux 2.37.2).

Änderungen werden vorerst nur im Speicher vorgenommen, bis Sie sich

entscheiden, sie zu schreiben.

Seien Sie vorsichtig, bevor Sie den Schreibbefehl anwenden.

Gerät enthält keine erkennbare Partitionstabelle.

Eine neue DOS-Festplattenbezeichnung 0xdc256c5b wurde erstellt.

Befehl (m für Hilfe): n

Partitionstyp

p Primär (0 primär, 0 erweitert, 4 frei)

e Erweitert (Container für logische Partitionen)

Wählen (Vorgabe p): p

Partitionsnummer (1-4, Vorgabe 1): 1

Erster Sektor (2048-104857599, Vorgabe 2048):

Letzter Sektor, +/-Sektoren oder +/-Größe{K,M,G,T,P} (2048-104857599, Vorgabe 104857599):

Eine neue Partition 1 des Typs „Linux“ und der Größe 50 GiB wurde erstellt.

Befehl (m für Hilfe): w

Die Partitionstabelle wurde verändert.

ioctl() wird aufgerufen, um die Partitionstabelle neu einzulesen.

Festplatten werden synchronisiert.

Prima, jetzt haben wir eine Partition /dev/sdb1, diese formatieren wir nun mit dem ext4 Dateisystem:

mkfs.ext4 /dev/sdb1

Ausgabe:

root@cloudserver:~# mkfs.ext4 /dev/sdb1

mke2fs 1.46.5 (30-Dec-2021)

Geräteblöcke werden verworfen: erledigt

Ein Dateisystem mit 13106944 (4k) Blöcken und 3276800 Inodes wird erzeugt.

UUID des Dateisystems: 2ead4117-e280-4ac4-8038-f41ef64c1e70

Superblock-Sicherungskopien gespeichert in den Blöcken:

32768, 98304, 163840, 229376, 294912, 819200, 884736, 1605632, 2654208,

4096000, 7962624, 11239424

beim Anfordern von Speicher für die Gruppentabellen: erledigt

Inode-Tabellen werden geschrieben: erledigt

Das Journal (65536 Blöcke) wird angelegt: fertig

Die Superblöcke und die Informationen über die Dateisystemnutzung werden

geschrieben: erledigt

Nun müssen wir die Festplatte noch mounten. Seafile werden wir nach

/home/seafile/haiwen

installieren. Deshalb hängen wir die neue Festplatte unterhalb von /home ein.

Dort liegt aber noch ggf. das Verzeichnis unseres installadmin, das verschieben wir so lange:

mv /home/installadmin /tmp/installadmin

Mounten wir unsere neue Partition an diesen Pfad:

mount /dev/sdb1 /home/

Prüfen wir ob das geklappt hat:

root@cloudserver:~# df -h Dateisystem Größe Benutzt Verf. Verw% Eingehängt auf tmpfs 391M 1,2M 390M 1% /run /dev/sda2 32G 7,5G 23G 26% / tmpfs 2,0G 0 2,0G 0% /dev/shm tmpfs 5,0M 0 5,0M 0% /run/lock tmpfs 391M 4,0K 391M 1% /run/user/1000 /dev/sdb1 49G 24K 47G 1% /home

In der letzten Zeile sehen wir das es geklappt hat.

Nun müssen wir dafür sorgen das dies auch beim nächsten Booten automatisch gemacht wird. Dazu brauchen wir die UUID die wir wie folgt herausbekommen:

ls -l /dev/disk/by-uuid/ | grep sdb

Ergebnis bei mir:

lrwxrwxrwx 1 root root 10 Jan 29 11:10 2ead4117-e280-4ac4-8038-f41ef64c1e70 -> ../../sdb1

Nun bearbeiten wir die fstab:

nano /etc/fstab

und hängen unten folgende Zeile an:

/dev/disk/by-uuid/2ead4117-e280-4ac4-8038-f41ef64c1e70 /var/www ext4 defaults 0 1

Die Werte bedeuten:

/dev/disk/by-uuid/2ead4117-e280-4ac4-8038-f41ef64c1e70 : Pfad mit UUID des Datenträgers /var/www : Das Verzeichnis in das gemountet werden soll ext4 : Welches Dateisystem soll gemountet werden, ggf. auch mit auto probieren defaults : Mit Standardeinstellungen / Rechten mounten, Detail siehe z.B. hier: https://wiki.archlinux.de/title/Fstab 0 : Für den Befehl Dump, 0 bedeutet "keine Systempartition" 0 : Für Dateisystemprüfung, 1 bedeutet "mit Prüfung" einbinden

Bevor wir nun neu Starten verschieben wir noch das installadmin Verzeichnis zurück:

mv /tmp/installadmin /home/installadmin

Als Test nun einen Reboot - danach sollte die Platte weiterhin/wieder eingehängt sein. Das könnte ihr wieder mit df -h kontrollieren:

Dateisystem Größe Benutzt Verf. Verw% Eingehängt auf tmpfs 391M 1,2M 390M 1% /run /dev/sda2 32G 7,5G 23G 26% / tmpfs 2,0G 0 2,0G 0% /dev/shm tmpfs 5,0M 0 5,0M 0% /run/lock /dev/sdb1 49G 40K 47G 1% /home tmpfs 391M 4,0K 391M 1% /run/user/1000

Benötigte Pakete installieren

Folgende Programmpakte sollten Installiert sein (ermöglicht sowohl die Community als auch die Professionell Version):

apt install -y apache2 mariadb-server apt install -y python3 python3-dev python3-setuptools python3-pip libmysqlclient-dev ldap-utils libldap2-dev apt install -y memcached libmemcached-dev

und im Anschluß den pip3 Befehl:

pip3 install --timeout=3600 django==4.2.* future==0.18.* mysqlclient==2.1.* pymysql pillow==10.2.* pylibmc captcha==0.5.* markupsafe==2.0.1 jinja2 sqlalchemy==2.0.18 psd-tools django-pylibmc django_simple_captcha==0.6.* djangosaml2==1.5.* pysaml2==7.2.* pycryptodome==3.16.* cffi==1.16.0 lxml python-ldap==3.4.3

Da ist auch gleich der Apache-Webserver (wird als Reverse-Proxy genutzt) und MariaDB (MySQL-Alternative) für die Datenbanken dabei.

Seafile Benutzer und Verzeichnisse anlegen

Wir erstellen einen Benutzer seafile dessen Home-Verzeichnis gleichzeitig unser Seafile-Installationsordner ist. Den Pfad müsst Ihr ggf. an eure Wünsche oder Verhältnisse anpassen, bei mir ist der ganze freie Speicherplatz unter /home - dort habe ich auch die zusätzliche Festplatte eingehängt.

aadduser --disabled-login --gecos "Seafile" seafile --home /home/seafile/

Wir wechseln auf diesen eben neu erstellten Benutzer:

sudo -u seafile /usr/bin/bash

und wechseln in das Heimatverzeichnis des Benutzers - also in

cd /home/seafile/ cd ~

Nun noch schnell 3 Sprachanpassungen damit es nachher keine Fehlermeldungen gibt:

echo "export LC_ALL=de_DE.UTF-8" >>~/.bashrc echo "export LANG=de_DE.UTF-8" >>~/.bashrc echo "export LANGUAGE=de_DE.UTF-8" >>~/.bashrc source ~/.bashrc

Wir erstellen nun einen neuen Ordner haiwen und wechseln in diesen:

mkdir haiwen cd haiwen

Warum haiwen? Der Ordner heisst "haiwen" weil Seafile wohl so im Chinesischen genannt wird. Ihr könnte auch jeden anderen Namen nehmen, müsst dann aber die Pfade anpassen

Eigentlich soll statt haiwen dann der Name eurer Organisation / Firma verwendet werden.

su - seafile wechselt Ihr ja zum Benutzer seafile - mit exit landet Ihr wieder in eurer ursprünglichen Sitzung

Python virtual environment erstellen

Wir sind als Benutzer seafile angemeldet und befinden uns im Ordner /home/seafile/haiwen!

python3 -m venv python-venv

- activate the venv

source python-venv/bin/activate